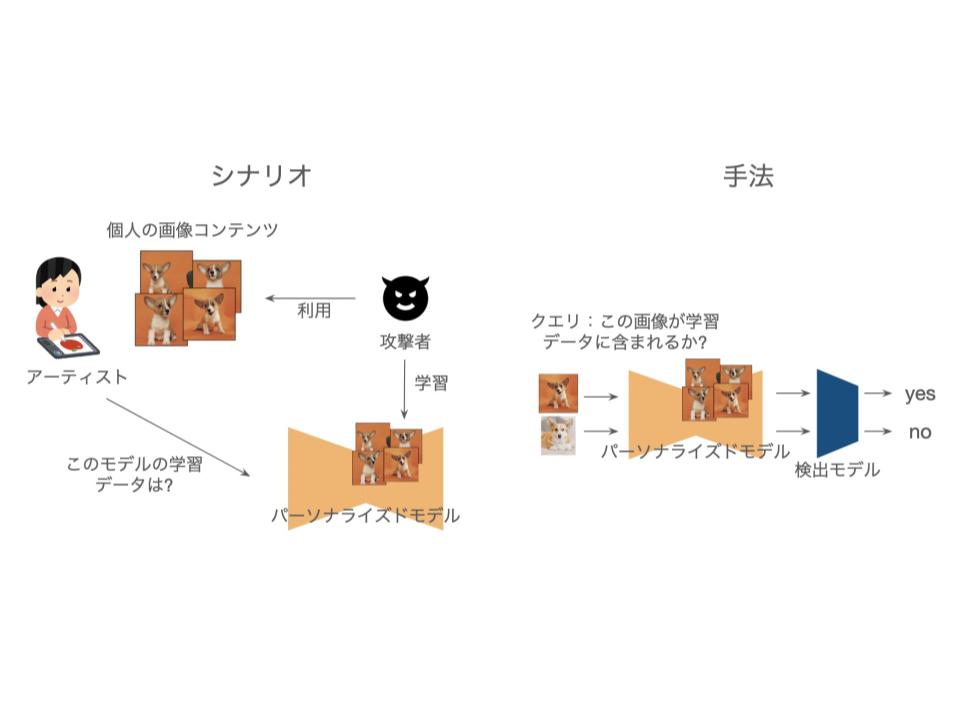

研究キーワード:#テキスト画像生成モデル #生成AI #データ保護 #AIの安全性 #メンバーシップ推論攻撃 1. 研究の概要 本研究ではStable Diffusionなどの生成モデルにパーソナライゼーションを施した前後の出力を詳細に比較することで、学習に用いられたデータを高い精度で検知できる手法を開発した。 2. 取り組んだ問題 パーソナライゼーションで著作権者の許諾なく追加学習されたモデルが公開され、アーティストの画風が無断で再現されてしまうリスクが深刻化している問題に対処した。 3. 研究のモチベーションと背景 生成AIがアーティストのスタイルやキャラクタIPを無許可で模倣可能な状況に懸念が高まり、著作権保護と創作活動の健全な発展を両立する技術的手段を模索する必要性が背景にある。 4. 得られた結果 パーソナライゼーション前後のモデル出力を比較するアプローチによって、モデルのパーソナライゼーションモデルの学習に使用されたデータを高精度で検出できる手法を開発しました。 5. 価値交換(分析/生成)との関わりと、研究が社会に与えうるインパクト 生成AIの安全性の向上とアーティストや知的財産を保有する企業の権利保護に寄与する成果であり、近年社会での利用が急速に拡大する生成AI技術のリスクを抑えることで社会への技術のさらなる普及に貢献する。

Research Key word: #Text-to-image_models #GenerativeAI #data_privacy #AIsafety #membership_inference_attack 1. Overview of the research In this research, we developed a method to detect the data used for training with high accuracy by conducting a detailed comparison of outputs before and after personalization is applied to generative models like Stable Diffusion. 2. The problem addressed: In this study, we developed a method to accurately detect the data used for training by conducting a detailed comparison of outputs before and after personalization is applied to generative models such as Stable Diffusion. 3. Research motivation and background: There is growing concern about the ability of generative AI to imitate artists' styles and character IPs without permission, creating a need to explore technical means that balance copyright protection with the healthy development of creative activities. 4. Results obtained: By using an approach that compares the model outputs before and after personalization, we developed a method that can accurately detect the data used in the training of personalized models. 5. Relationship with value exchange (analysis/creation) and the potential impact of that research on society: This contributes to enhancing the safety of generative AI and protecting the rights of artists and companies holding intellectual property. By mitigating the risks associated with the rapidly expanding use of generative AI technology in society, it supports the further dissemination of the technology.

PUBLICATIONS

- Kai Katsumata, Minh Duc Vo, Tatsuya Harada, Hideki Nakayama, Soft Curriculum for Learning Conditional GANs with Noisy-Labeled and Uncurated Unlabeled Data, Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision (WACV) 2024, Waikoloa Village, Hawaii, 2024/01

- Kai Katsumata, Duc Minh Vo, Hideki Nakayama, Label Augmentation As Inter-Class Data Augmentation for Conditional Image Synthesis With Imbalanced Data , Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision (WACV), 2024, Waikoloa Village, Hawaii, 2024/01